Данные под замком

Регуляторные барьеры, риск утечки и юридические ограничения мешают делиться сырыми данными с партнёрами.

Метод конфиденциальных вычислений для обучения ML‑моделей без передачи и разглашения персональных данных. Продукт федеративного обучения — DigiTrack Confidential Computing.

Регуляторные барьеры, риск утечки и юридические ограничения мешают делиться сырыми данными с партнёрами.

У каждого участника не хватает объёма данных. Модели переобучаются и не масштабируются.

Упущенные инсайты и упущенная выручка. Совместные модели повышают точность и дают ROI для всех сторон.

Техника машинного обучения, при которой данные из разных источников используются для обучения моделей, при этом данные остаются на стороне их владельцев. Наша платформа DigiTrack Confidential Computing реализует эту технологию для бизнеса.

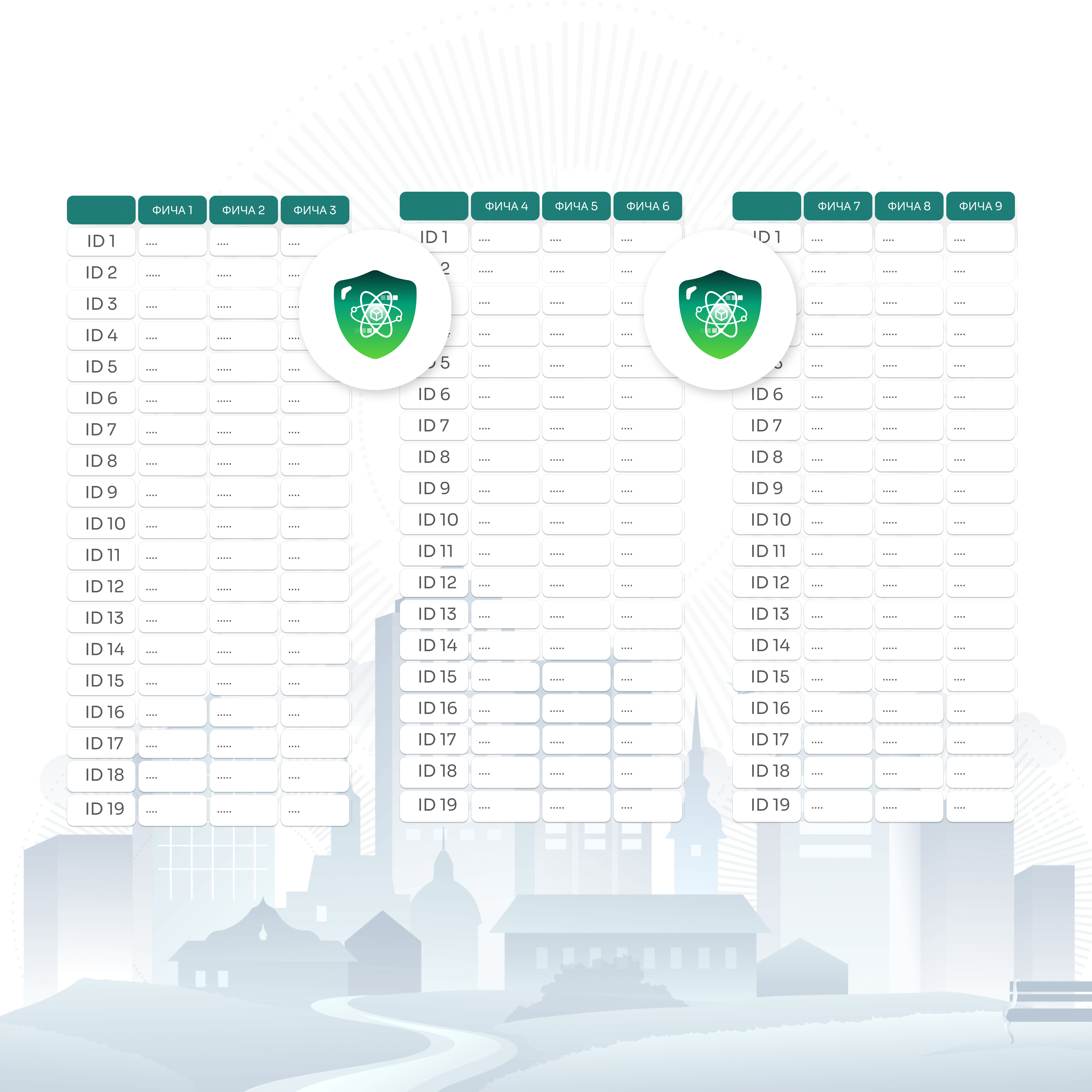

• Договоренность о создании совместной модели

• Приобретение ПО и лицензий

• Назначение координатора

• Загрузка данных в ПО

• Безопасное сопоставление записей

• Определение общих объектов

• Загрузка признаков по общим объектам

• Локальные вычисления

• Передача векторов оптимизации в зашифрованном виде

• Объединение промежуточных результатов

• Получение итогового прогноза

• Формирование распределённой модели

Есть два возможных варианта проведения обучения

Данные разных пользователей, но с одинаковыми признаками.

Данные про одних и тех же пользователей, но с разными признаками.

Установить программу федеративного обучения DigiTrack Confidential Computing можно оставив заявку по форме ниже.

Следите за нашими достижениями и обновлениями

Как объединить данные с одинаковыми пользователями, но разными признаками для создания более точных моделей машинного обучения

Узнать больше →

Обучение моделей на распределенных данных с одинаковыми признаками, но разными пользователями для повышения обобщающей способности

Узнать больше →

Тренды и перспективы развития технологий защиты данных в эпоху искусственного интеллекта и больших данных

Узнать больше →